Tesla Model 3 sbatte contro un'auto della polizia: nel mirino l'Autopilot

Una Tesla Model 3 con l'Autopilot attivo va a sbattere contro un'auto della polizia.

Sembra che per l'Autopilot di Tesla non ci sia pace. Un paio di settimane fa era arrivata la notizia che la NHTSA aveva deciso di avviare un'inchiesta sulla tecnologia di guida assistita del costruttore americano che porterà ad indagare sulle cause di 11 incidenti avvenuti da inizio 2018 che hanno determinato un decesso e 17 feriti. Adesso, l'Autopilot è tornato nuovamente sotto i riflettori a causa di un incidente che ha coinvolto una Tesla Model 3 in Florida.

A quanto si apprende, sabato mattina, vicino ad Orlando, l'auto elettrica con l'Autopilot inserito ha urtato il lato sinistro di un'auto della polizia ferma sul ciglio della strada con i lampeggianti accesi per soccorrere un veicolo in panne (una Mercedes) che è stato a sua volta colpito dalla Tesla. Nello scontro, l'agente di polizia è rimasto illeso, mentre il conducente della Tesla e quello dell'auto in panne hanno riportato solo lievi ferite.

Happening now: Orange County. Trooper stopped to help a disabled motorist on I-4. When Tesla driving on “auto” mode struck the patrol car. Trooper was outside of car and extremely lucky to have not been struck. #moveover. WB lanes of I-4 remain block as scene is being cleared. pic.twitter.com/w9N7cE4bAR

— FHP Orlando (@FHPOrlando) August 28, 2021

La polizia della Florida ha detto che avrebbe segnalato l'incidente alla NHTSA e a Tesla. Le indagini permetteranno di capire l'esatta dinamica dell'incidente che poteva avere conseguenze ben peggiori. Indubbiamente, però, quanto accaduto potrebbe dare alla NHTSA nuovo materiale su cui lavorare per la sua inchiesta. Vale la pena notare che in passato l'Autopilot era stato accusato più volte ma alla fine era stato "assolto" dalle responsabilità degli incidenti in quanto la colpa era poi ricaduta sui conducenti che non avevano utilizzato correttamente il sistema di guida assistita.

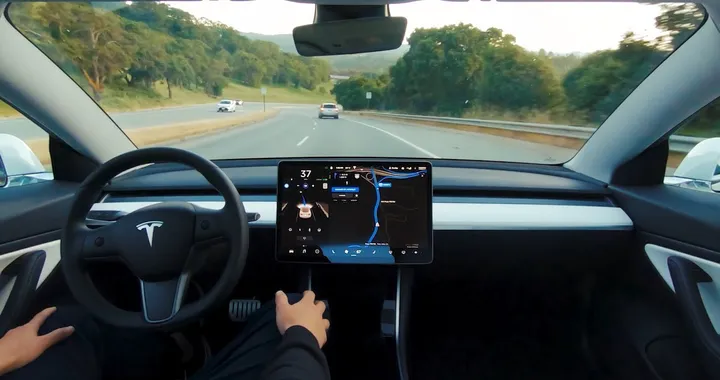

Come noto, i conducenti devono sempre mantenere salde le mani sul volante e prestare attenzione alla guida per poter intervenire in caso di necessità. Il problema spesso è che molti possessori delle Tesla pensano che le loro auto siano in grado di poter guidare da sole. Nel corso del tempo sono emersi comportamenti davvero pericolosi da parte di alcune persone. Si pensi, per esempio, a quanto successo lo scorso anno in Canada quando un giovane è stato trovato a "sonnecchiare" con il sedile inclinato, lasciando che la sua Model S guidasse da sola.

Non rimane, a questo punto, che attendere novità sull'incidente e soprattutto sull'inchiesta che la NHTSA ha deciso di portare avanti. Tesla non ha commentato l'incidente ma nel suo ultimo rapporto sulla sicurezza ha evidenziato che ha registrato un incidente ogni 4,19 milioni di miglia percorse in cui i conducenti avevano attivato l'Autopilot. I dati più recenti di NHTSA, aveva sottolineato il costruttore, mostrano che negli Stati Uniti c'è un incidente automobilistico ogni 484.000 miglia. Un modo per dire che le sue auto con l'Autopilot attivo hanno meno incidenti rispetto alla media.